Управление роботом "по щелчку пальцев" придумали в ИТИС

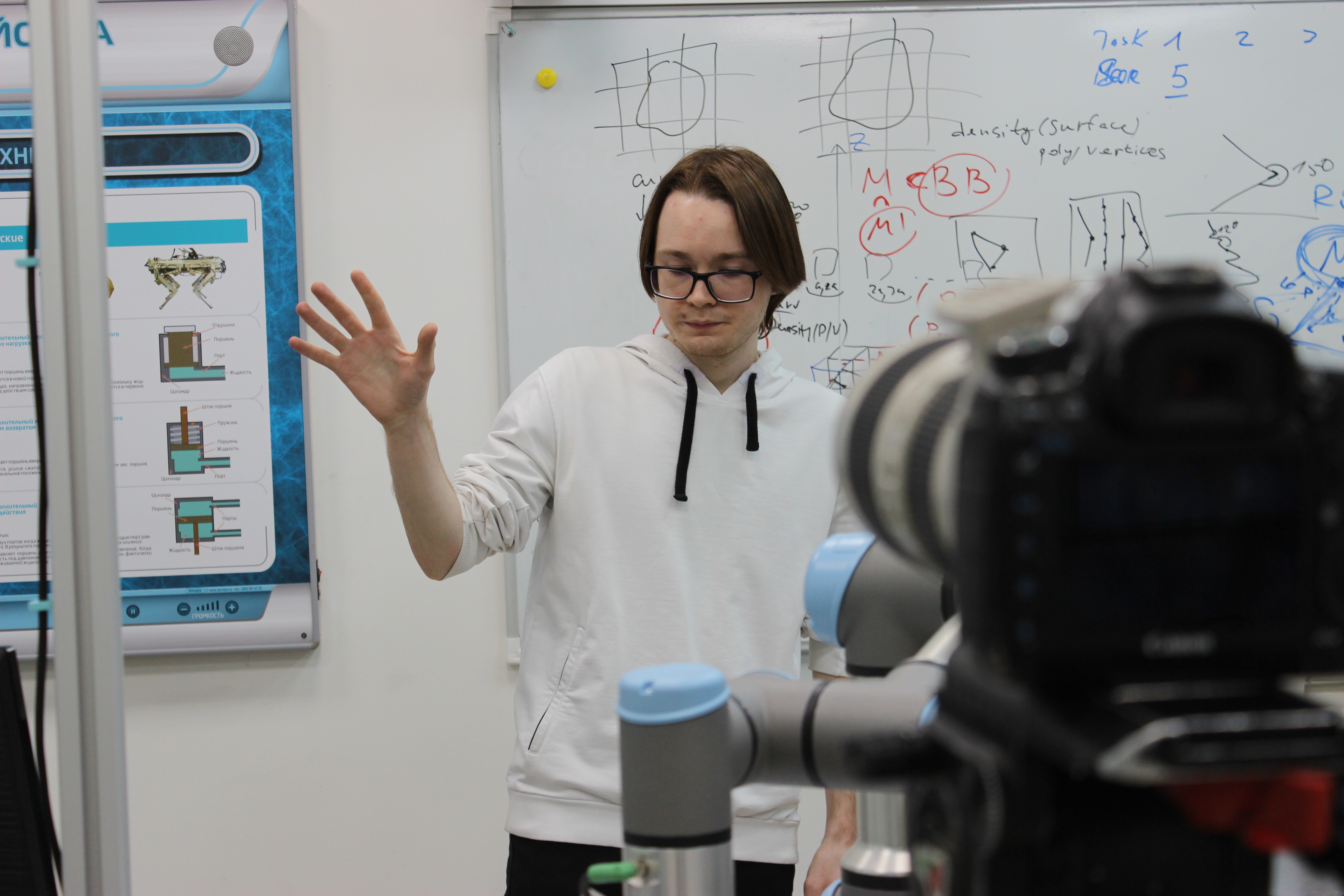

Чтобы робот понимал команды можно использовать пульт управления, а можно – жесты. Но не все движения человека понятны машинам, поэтому в лаборатории интеллектуальных робототехнических систем ИТИС придумали пользовательский интерфейс на основе компьютерного зрения для определения положения рук.

«Программа интерфейса дополненной реальности для управления роботом Universal Robots UR5e при коллаборативной сборке учебного мобильного робота» и «Программа для интерпретации жестов человека-оператора для управления роботом UR5e с помощью компьютерного зрения» недавно получили свидетельство о государственной регистрации программ для ЭВМ. Сотрудники лаборатории интеллектуальных робототехнических систем ИТИС объяснили необходимость таких решений.

«Это облегчает процесс работы с роботом и делает взаимодействие с ним немного интереснее. Человеку нет надобности использовать родной для робота пульт обучения для управления. Этот пульт достаточно увесистый, обладает марким глянцевым экраном.» - отметил один из авторов идеи, лаборант-исследователь ЛИРС Максим Мустафин.

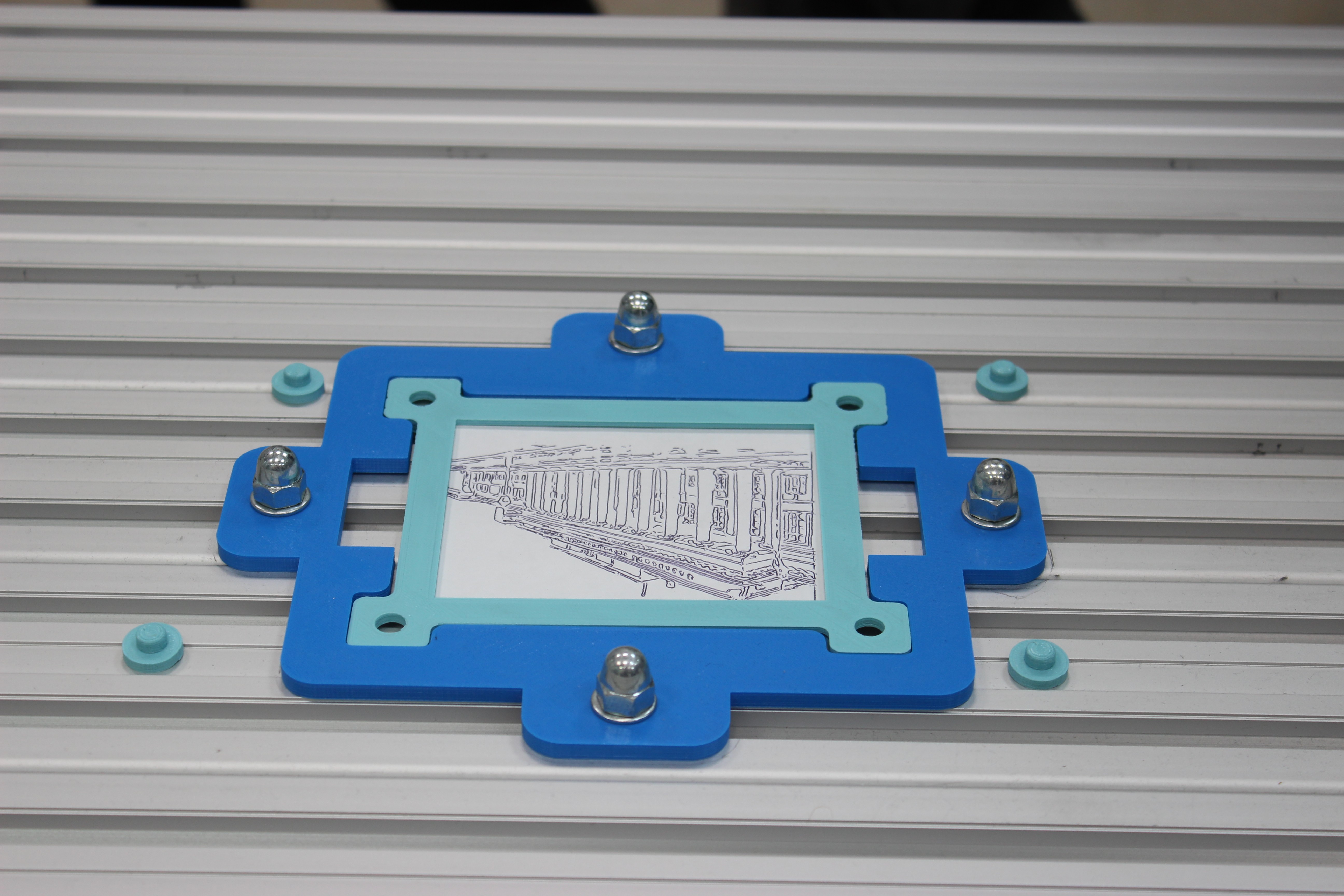

Теперь, благодаря новому интерфейсу, можно определять положение пальцев рук пользователя на изображении и распознавать различные жесты человека для управления роботом. Для этого нужна лишь веб-камера и компьютер с хорошей производительностью. Но, чтобы избежать некорректной интерпретации роботом жестов, и как следствие, выполнение команд, которые не были предусмотрены пользователем, провели ряд тестов.

«По результатам эксперимента выяснилось, что одним участникам неудобно показывать одни жесты, а другим участникам неудобно показывать другие жесты. Поэтому было принято решение по разработке интерфейса, для взаимодействия с которым необходим один жест, который является физиологически удобным для человека.» - рассказал лаборант-исследователь ЛИРС Максим Мустафин.

Как это выглядит? Человек-оператор смыкает кончики указательного и большого пальца для нажатия на "виртуальные" кнопки. Таким образом, он использует один жест для взаимодействия с элементами интерфейса на основе компьютерного зрения для управления роботом.

На данный момент проект находится на этапе активной разработки прототипов и апробации идей по улучшению интерфейса. По словам учёных ЛИРС с каждым новым экспериментом они видят всё больше путей развития этой идеи.