Проект программы «Приоритет 2030» (2022-2025)

Регистрационный номер проекта в ЕГИСУ НИОКТР:

122071900025-3 (2023), 124110700006-8 (2024), 125091010199-2 (2025)

Руководитель проекта: старший научный сотрудник Осокин Сергей Игоревич (2022-2023), младший научный сотрудник Цой Татьяна Григорьевна (2024), ведущий научный сотрудник Чеботарева Эльвира Валерьевна (2025)

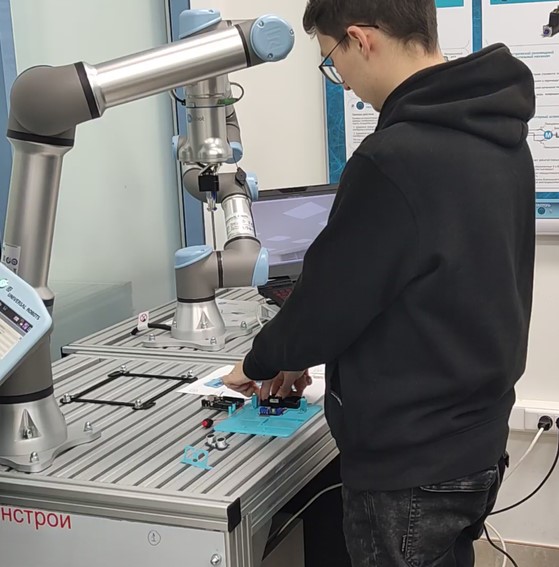

Проект направлен на создание системы управления промышленным коллаборативным манипулятором, которая в том числе поможет повысить безопасность коллаборативного взаимодействия робота и человека в задачах современного производства. В рамках проекта были получены научные и прикладные результаты по следующим направлениям:

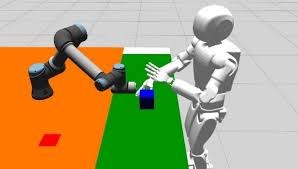

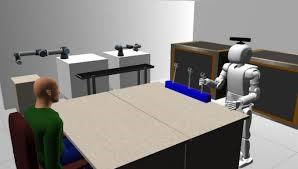

Моделирование и верификация сценариев совместной работы человека и робота в виртуальных средах

Данное направление посвящено разработке и использованию цифровых двойников для отработки, тестирования и анализа сценариев совместной деятельности человека и робота в безопасной и контролируемой виртуальной среде. Основным инструментом является симулятор Gazebo, в котором создаются модели робототехнических ячеек, промышленных манипуляторов и реалистичные антропоморфные модели человека. Работы включают создание библиотек моделей оператора, анализ потенциальных столкновений, моделирование действий человека и оценку безопасности взаимодействия. Такой подход позволяет на ранних этапах выявлять риски, оптимизировать рабочие процессы и протоколы совместной деятельности, а также проводить масштабируемые и воспроизводимые эксперименты без привлечения дорогостоящего физического оборудования и без угрозы для человека. Методы проверки обеспечивают корректный перенос отработанных решений в реальные промышленные и исследовательские системы.

Проектирование интерфейсов и оценка эргономики совместной работы человека и робота

Данное научное направление сфокусировано на разработке и изучении интуитивных интерфейсов человеко-машинного взаимодействия для обеспечения эффективной и безопасной кооперации человека и робота в коллаборативных сценариях. Основными объектами исследования выступают бесконтактные системы жестового управления и интерфейсы на основе технологий дополненной реальности, обеспечивающие контекстную визуализацию информации и пространственное наложение инструктивных элементов. В рамках направления проводится комплексная эргономическая оценка совместной деятельности, включающая исследование пользовательского опыта, исследование динамики психофизиологического состояния оператора и оптимизацию распределения функций в системе «человек-робот». Конечной целью исследований является минимизация когнитивной нагрузки оператора, снижение вероятности ошибок при взаимодействии и максимизация производительности коллаборативной робототехнической ячейки. Результаты работ направлены на формирование комфортной и естественной для человека среды взаимодействия с автономными системами в прикладных областях, таких как гибкое производство, логистика и сервисная робототехника.

Обеспечение безопасности и разработка систем мониторинга для роботизированных коллаборативных ячеек

Направление сосредоточено на решении проблемы обеспечения физической безопасности в гибридных рабочих пространствах коллаборативных робототехнических систем. Ключевой задачей является создание предиктивных систем мониторинга и предотвращения коллизий, функционирующих в режиме реального времени. Методологическая основа исследований включает разработку детерминированных и вероятностных моделей для расчета зон безопасности, учитывающих кинематические и динамические параметры манипулятора.

Фундаментальной составляющей является синтез данных от камер, лазерных дальномеров и тактильных матриц с применением алгоритмов слияния для построения единого поля пространственного восприятия и трекинга агентов. На основе получаемой мультимодальной информации синтезируются адаптивные протоколы управления. Все разрабатываемые решения проходят многоуровневую верификацию: от валидации в симуляционных средах с использованием цифровых двойников для моделирования критических сценариев до контролируемых натурных экспериментов с метрической оценкой временных и пространственных характеристик безопасности.

Полученные результаты были описаны в серии научных статей, представленных на профильных конференциях по робототехнике и опубликованных в международных журналах; 3 технологические решения были зафиксированы в виде государственной регистрации программ ЭВМ.

Статьи

[1] Chebotareva E., Mukhamedshin A., Imamov N., Magid E. Object Localization Based on a Single RGB Camera for a 4-DOF Robotic Arm // 11th International Conference on Automation, Robotics, and Applications. – IEEE, 2025. – pp. 252-256.

[2] Zagirov A. I., Chebotareva E. V., Osokin S. I. Human collision with moving objects in Gazebo environment // International Conference on Information, Control, and Communication Technologies (ICCT 2024). – 2024. – pp. 187-189.

[3] Chebotareva E., Mustafin M., Safin R., Tsoy T., Martinez-Garcia E.A., Li H., Magid E. Camera-based safety system for collaborative assembly // Journal of Intelligent Manufacturing. – Springer Nature, 2024. – 36. – 5593-5611.

[4] Mustafin M., Tsoy T., Bai Y., Svinin M., Chebotareva E. Augmented Reality Interface for UR5e Robot that Transfers Parts to a Human in Collaborative Assembly // International Conference on Interactive Collaborative Robotics. – Cham : Springer Nature Switzerland, 2024. – pp. 1-14.

[5] Zagirov A., Chebotareva E., Osokin S., Li H., Magid E. User Perception and Evaluation of a Portrait Drawn by KUKA KR3 AGILUS Manipulator // International Conference on Interactive Collaborative Robotics. – Cham : Springer Nature Switzerland, 2024. – pp. 45-58.

[6] Zagitov A., Chebotareva E., Toschev A., Magid E. Comparative analysis of neural network models performance on low-power devices for a real-time object detection task // Computer Optics. – 2024. – Vol. 48(2). – pp. 242-252.

[7] Kolin N., Chebotareva E. A Comparative Analysis of Object Detection Methods for Robotic Grasping // International Conference on Artificial Life and Robotics (ICAROB 2024). – 2024. – Vol.29. – pp. 304-307.

[8] Sultanov R., Sulaiman S., Tsoy T., Chebotareva E. Virtual Collaborative Cells Modelling for UR3 and UR5 Robots in Gazebo Simulator // The 2023 International Conference on Artificial Life and Robotics (online, 9-12 February) – pp. 150-153.

[9] Mustafin M., Chebotareva E., Magid E., Li, H., Martinez-Garcia E. Features of Interaction Between a Human and a Gestures-Controlled Collaborative Robot in an Assembly Task: Pilot Experiments // The 2023 International Conferenc on Artificial Life and Robotics (online, 9-12 February) – pp. 158-162.

[10] Zagirov A., Apurin A., Chebotareva E. Modeling of Human Actions in a Collaborative Robot Space Using AR601M Humanoid Robot: Pilot Experiments in the Gazebo Simulator // The 2023 International Conference on Artificial Life and Robotics (online, 9-12 February) – pp. 163-166.

[11] Kidiraliev E., Lavrenov R. Using optical sensors for industrial robot-human interaction in a Gazebo simulator // The 2023 International Conference on Artificial Life and Robotics (online, 9-12 February) – pp. 173-177.

[12] Dobrokvashina A., Zagirov A., Chebotareva E., Hsia K-H, Magid E., Sulaiman S. Human robot interaction in collaborative manufacturing scenarios: prospective case // Siberian Conference on Control and Communications, (SIBCON 2022) (online, 17-19 November 2022) – p. 1-6.

[13] Sultanov R., Sulaiman S., Li H., Meshcheryakov R., Magid E. A review on collaborative robots used in industrial and service sectors // Siberian Conference on Control and Communications, (SIBCON 2022) (online, 17-19 November 2022) – p. 1-7.

[14] Tsoy T., Safin R., Martinez-Garcia E.A., Roy S.D., Saha S.K., Magid E. Exhaustive simulation approach for a virtual camera calibration evaluation in Gazebo // IEEE 8th International Conference on Automation, Robotics and Applications (ICARA 2022) (online; 18-20 February 2022) – p. 233-238.

[15] Zagidullin L., Tsoy T., Meshcheryakov R., Hsia K.-H., Magid E. Numerical Solution Approach for the ROBOTIS OP2 Humanoid Hand Inverse Kinematics // International Conference on Artificial Life and Robotics (ICAROB 2022) (online; 20-23 January 2022) – p. 682-685.